LM 스튜디오는 사용자 친화적인 데스크톱 애플리케이션이며, 리눅스 머신에서 대형 언어 모델(LLMs)을 로컬에 다운로드, 설치, 실행할 수 있게 해줍니다.

LM 스튜디오를 사용하면 클라우드 기반 AI 모델과 관련된 제한 사항과 개인 정보 보호 우려를 벗어나면서도 친숙한 ChatGPT 스타일 인터페이스를 즐길 수 있습니다.

이 기사에서는 LM 스튜디오를 리눅스에 AppImage 형식으로 설치하는 방법을 안내하고, 특정 LLM 모델을 로컬에서 실행하는 예제를 제공합니다.

시스템 요구 사항

LM 스튜디오를 리눅스에서 실행하기 위한 최소 하드웨어 및 소프트웨어 요구 사항은 다음과 같습니다:

- 최소 8GB의 VRAM을 갖춘 할당된 NVIDIA 또는 AMD 그래픽 카드.

- AVX2 호환 프로세서와 최소 16GB의 RAM.

리눅스에 LM 스튜디오 설치

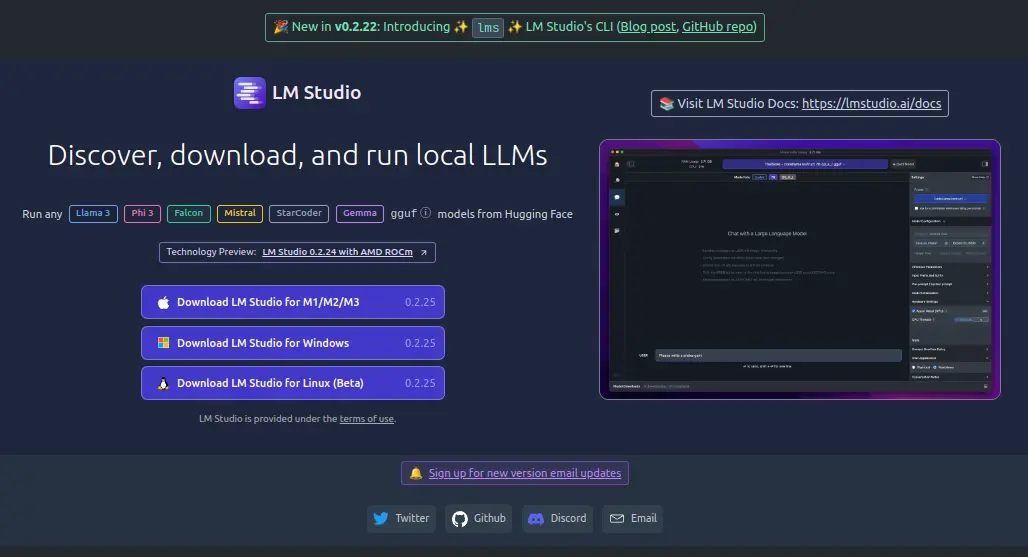

시작하려면, 공식 웹사이트나 저장소에서 최신 LM 스튜디오 AppImage를 다운로드해야 합니다.

AppImage를 다운로드한 후, 실행 파일로 만들고 AppImage 내용을 추출해야 합니다. 추출된 내용은 squashfs-root라는 디렉토리에 풀어집니다.

chmod u+x LM_Studio-*.AppImage ./LM_Studio-*.AppImage --appimage-extract

이제 추출된 squashfs-root 디렉토리로 이동하여 애플리케이션이 안전하게 실행하기 위해 필요한 도우미 바이너리 파일인 chrome-sandbox 파일에 적절한 권한을 설정해야 합니다.

cd squashfs-root sudo chown root:root chrome-sandbox sudo chmod 4755 chrome-sandbox

NOW LM Studio 应用程序可以从提取的文件直接运行。

./lm-studio

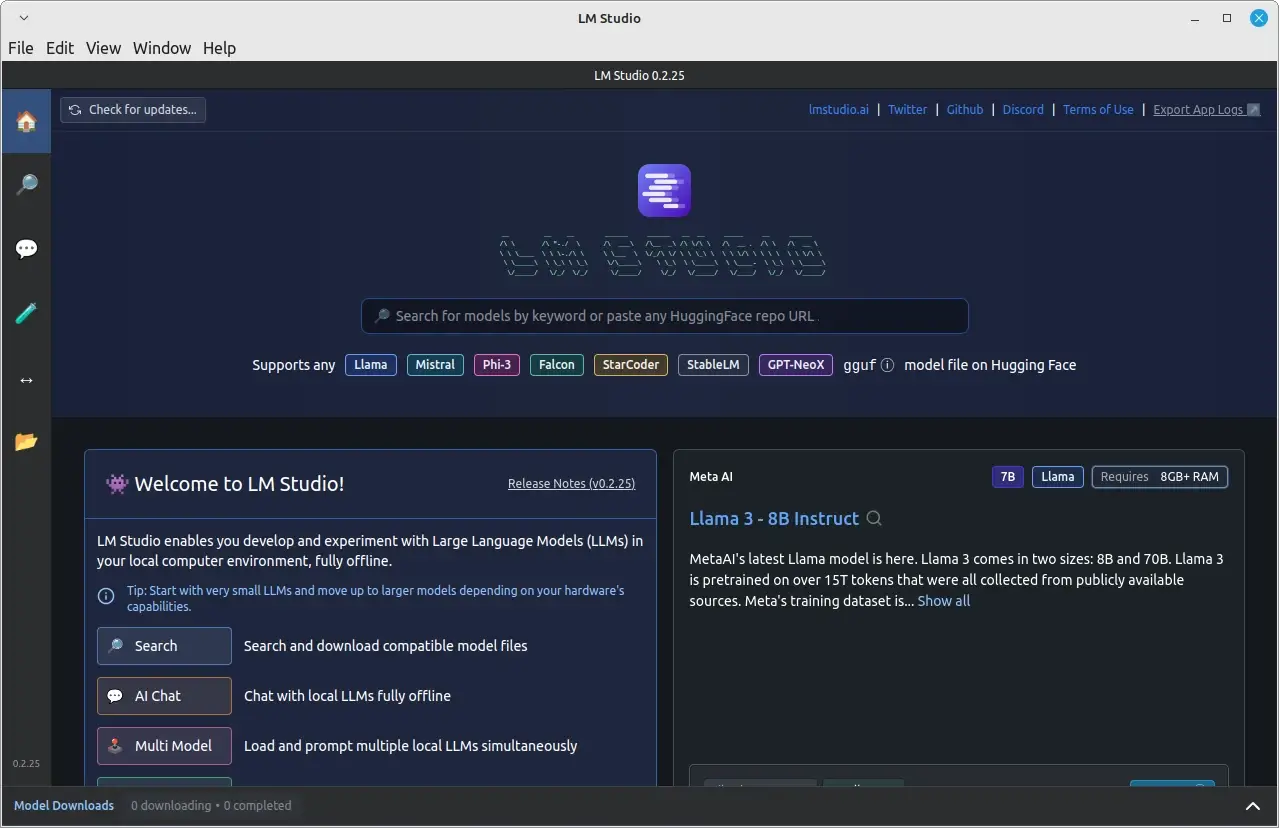

就这样!LM Studio 现已安装在您的 Linux 系统上,您可以开始探索并运行本地 LLM。

在 Linux 上本地运行语言模型

成功安装并运行 LM Studio 后,您可以开始使用它来本地运行语言模型。

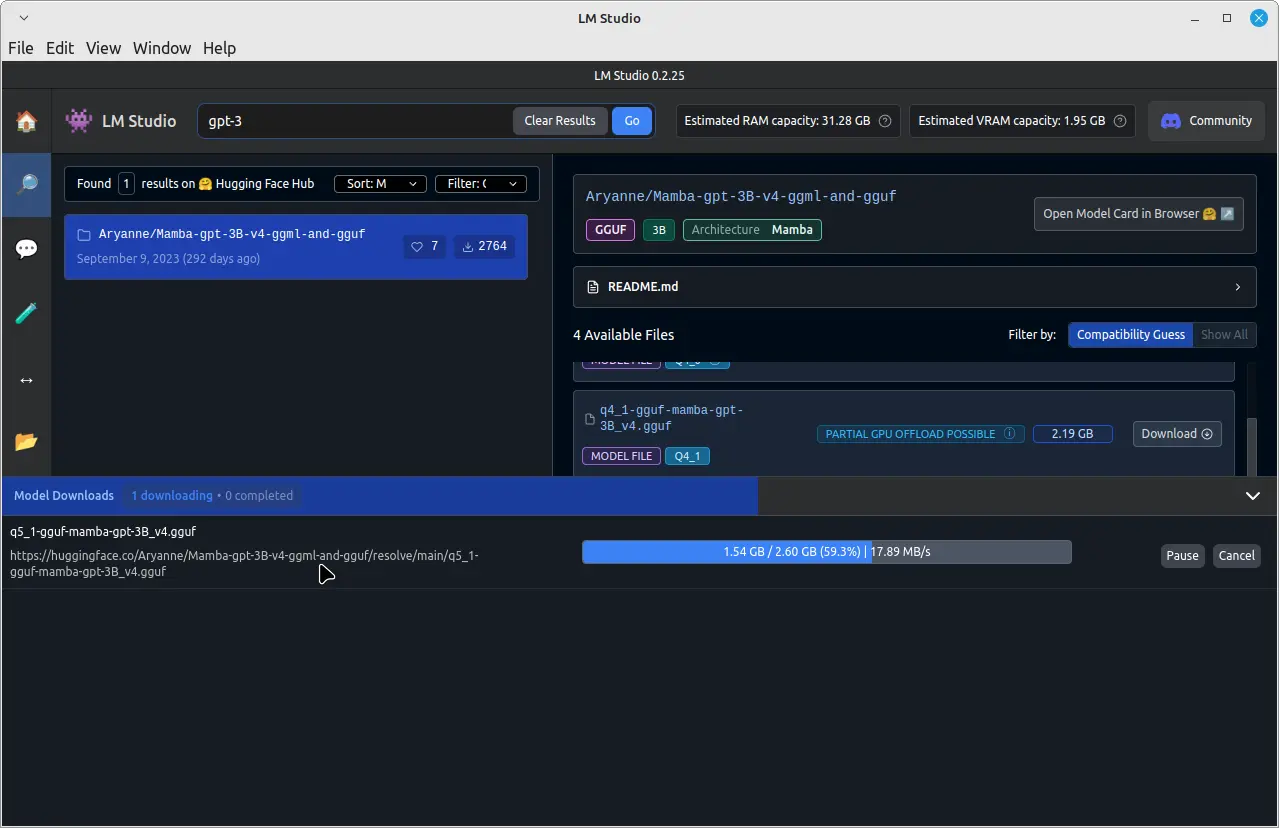

例如,要运行一个名为 GPT-3 的预训练语言模型,请点击顶部的搜索栏并输入“GPT-3”然后下载它。

下载完成后,点击左侧窗格中的“聊天”选项卡。在“聊天”选项卡中,点击顶部的下拉菜单并选择下载的 GPT-3 模型。

现在,您可以通过在聊天窗口底部的输入字段中键入消息来与 GPT-3 模型开始聊天。

GPT-3 模型将处理您的消息并提供基于其训练的响应。请注意,响应时间可能取决于您的系统硬件和下载模型的大小。

结论

通过使用 LM Studio AppImage 格式在您的 Linux 系统上安装 LM Studio,您可以轻松地下载、安装并在不依赖基于云的服务的情况下本地运行大型语言模型。

이것은 您의 数据과 隐私를 更大한 コントロールすることを同時に、先端 AI モデルの利点を楽しむことができます。 LLMsをダウンロードしてLM Studioを使用して実行する際には、知的財産権を常に尊重し、使用条項に従うようにしてください。