LM Studio è un’applicazione desktop user-friendly che ti permette di scaricare, installare ed eseguire grandi modelli linguistici (LLMs) localmente sulla tua macchina Linux.

Utilizzando LM Studio, puoi liberarti dalle limitazioni e dalle preoccupazioni di privacy associate ai modelli AI basati su cloud, godendoti comunque un’interfaccia simile a ChatGPT.

In questo articolo, ti guideremo attraverso l’installazione di LM Studio su Linux utilizzando il formato AppImage, e forniremo un esempio di esecuzione di un specifico modello LLM localmente.

Requisiti di sistema

I requisiti hardware e software minimi per eseguire LM Studio su Linux sono:

- Scheda grafica dedicata NVIDIA o AMD con almeno 8GB di VRAM.

- È richiesto un processore compatibile con AVX2 e almeno 16GB di RAM.

Installare LM Studio su Linux

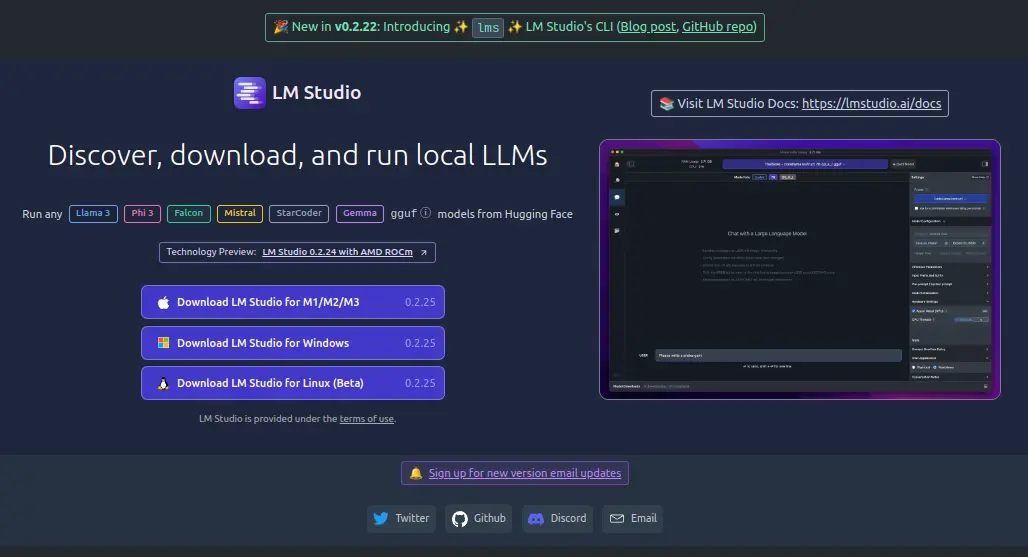

Per iniziare, devi scaricare l’ultimo LM Studio AppImage dal sito web ufficiale o dal repository.

Una volta scaricato l’AppImage, devi renderlo eseguibile ed estrarre i contenuti dell’AppImage, che si scompatterà in una directory chiamata squashfs-root.

chmod u+x LM_Studio-*.AppImage ./LM_Studio-*.AppImage --appimage-extract

Ora naviga nella directory estratta squashfs-root e imposta i permessi appropriati al file chrome-sandbox, che è un file binario di supporto che l’applicazione ha bisogno di eseguire in modo sicuro.

cd squashfs-root sudo chown root:root chrome-sandbox sudo chmod 4755 chrome-sandbox

Ora puoi avviare direttamente dai file estratti l’applicazione LM Studio.

./lm-studio

Ecco fatto! LM Studio è ora installato sul tuo sistema Linux e puoi iniziare ad esplorare e avviare modelli locali di Linguaggio.

Eseguire un Modello di Linguaggio Localmente in Linux

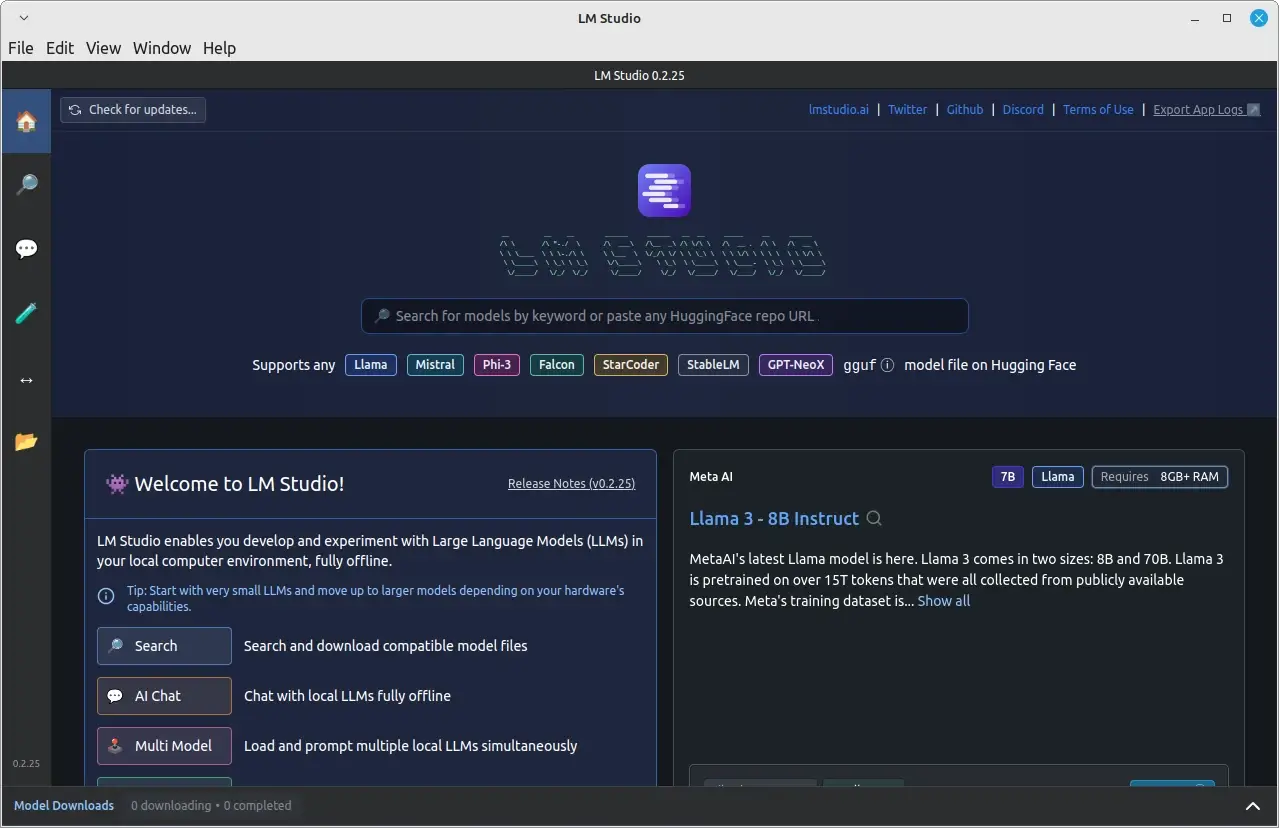

Dopo aver installato e avviato con successo LM Studio, puoi iniziare a usarlo per eseguire modelli di linguaggio localmente.

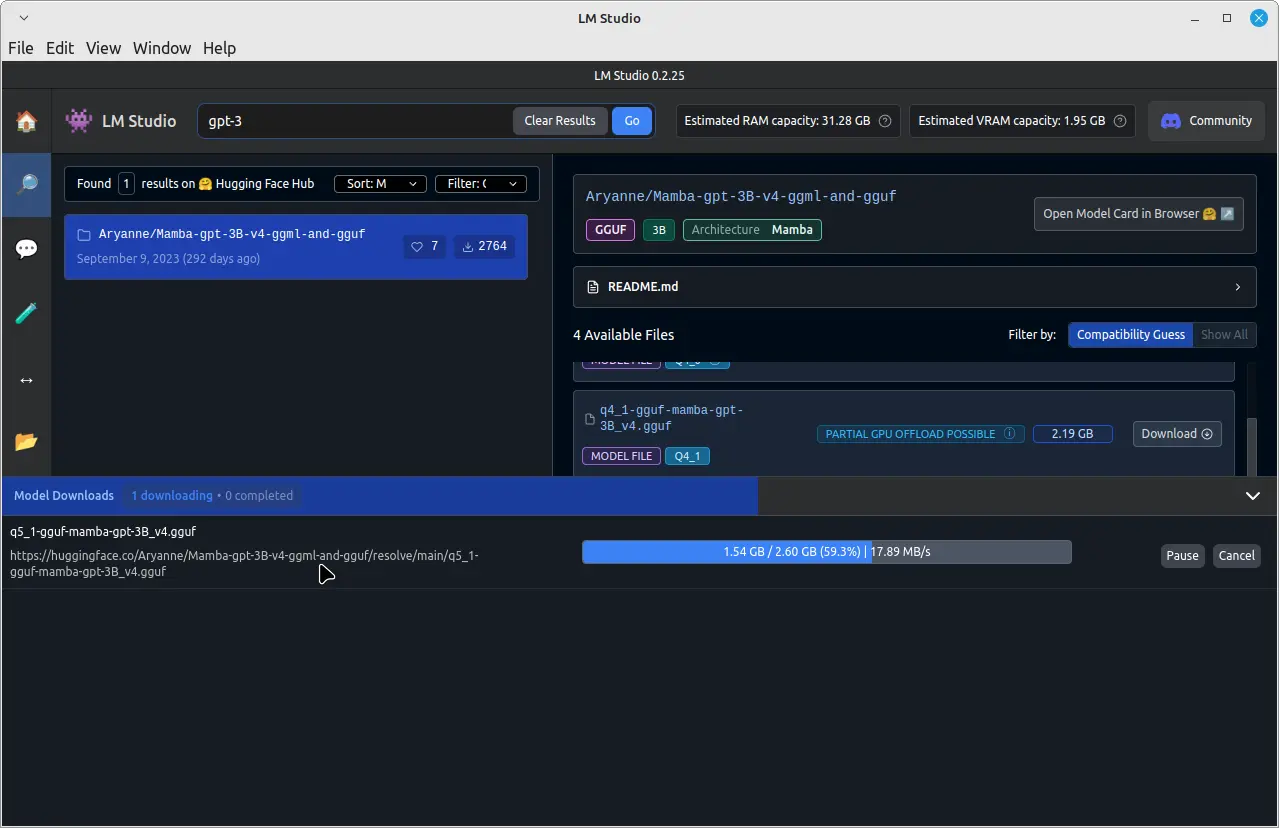

Per esempio, per eseguire un modello di linguaggio pre-addestrato chiamato GPT-3, clicca sulla barra di ricerca in alto e digita “GPT-3” e scaricalo.

Una volta completato il download, clicca sulla scheda “Chat” nel pannello sinistro. Nella scheda “Chat”, clicca sul menu a discesa in alto e seleziona il modello scaricato GPT-3.

Ora puoi iniziare a chattare con il modello GPT-3 digitando i tuoi messaggi nell’area di input in basso nella finestra di chat.

Il modello GPT-3 processerà i tuoi messaggi e fornirà risposte in base alla sua addestramento. ricorda che il tempo di risposta potrebbe variare in base alle prestazioni dell’hardware del tuo sistema e alla dimensione del modello scaricato.

Conclusione

Installando LM Studio sul tuo sistema Linux utilizzando il formato AppImage, puoi facilmente scaricare, installare e eseguire localmente modelli di linguaggio di grandi dimensioni senza dipendere da servizi basati sul cloud.

Questo vi dà un maggior controllo sul vostro data e privacy mentre godete ancora dei benefici di AI modelli avanzati. ricordare di rispettare sempre i diritti di proprietà intellettuale e di adeguarsi ai termini di utilizzo per i LLM che scaricate e eseguite utilizzando LM Studio.